智通財經APP獲悉,1月17日,商湯科技(00020)與上海AI實驗室聯合香港中文大學和復旦大學正式發佈新一代大語言模型書生·浦語2.0(InternLM2)。InternLM2 的核心理念在於迴歸語言建模的本質,致力於通過提高語料質量及信息密度,實現模型基座語言建模能力質的提升,進而在數理、代碼、對話、創作等各方面都取得長足進步,綜合性能達到開源模型的領先水平。

InternLM2是在2.6萬億token的高質量語料上訓練得到的。沿襲第一代書生·浦語(InternLM)的設定,InternLM2包含7B及20B兩種參數規格及基座、對話等版本,滿足不同複雜應用場景需求,繼續開源,提供免費商用授權。

迴歸語言建模本質,築牢大模型能力基礎

大模型的研究應迴歸語言建模本質,大模型各項性能提升的基礎在於語言建模能力的增強。爲此,聯合團隊提出了新一代的數據清洗過濾技術,通過更高質量的語料以及更高的信息密度,築牢大模型能力基礎。

主要發展了以下幾個方面的技術方法:

多維度數據價值評估:基於文本質量、信息質量、信息密度等維度對數據價值進行綜合評估與提升;

高質量語料驅動的數據富集:利用高質量語料的特徵從物理世界、互聯網以及語料庫中進一步富集類似語料;

針對性的數據補齊:針對性補充語料,重點加強現實世界知識、數理、代碼等核心能力。

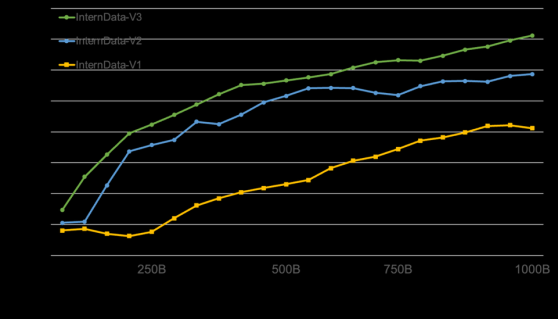

目前,浦語背後的數據清洗過濾技術已經歷三輪迭代升級。僅使用約60%的訓練數據即可達到使用第二代數據訓練1T tokens的性能表現,模型訓練效率大幅提升。

第三代數據清洗過濾技術大幅度提升模型訓練效率

基於第三代數據清洗過濾技術,InternLM2語言建模能力實現了顯著增強。

與第一代InternLM相比,InternLM2在大規模高質量的驗證語料上的Loss分佈整體左移,表明其語言建模能力實質性增強

支持200K超長上下文,“大海撈針”近乎完美

長語境輸入及理解能力能夠顯著拓展大模型應用場景,比如支持大型文檔處理、複雜的推理演算和實際場景的工具調用等。然而,大模型有限的上下文長度當前仍是學界及業內面臨的重要難題。通過拓展訓練窗口大小和位置編碼改進,InternLM2支持20萬 tokens的上下文,能夠一次性接受並處理約30萬漢字(約五六百頁的文檔)的輸入內容,準確提取關鍵信息,實現長文本中“大海撈針”。

參考業界範例,研究人員對InternLM2進行了“大海撈針”試驗:將關鍵信息隨機插入一段長文本的不同位置並設置問題,測試模型能否從中提取出關鍵信息。

InternLM2“大海撈針”試驗效果

上圖展示了InternLM2在不同長度的上下文(橫軸)及上下文中不同位置(縱軸)上召回關鍵信息的準確率(Recall)。紅色代表較低的召回準確率,而綠色則代表較高的召回率。試驗結果表明,InternLM2在上下文長度延展到200K時依舊保持了近乎完美的召回成功率,驗證了InternLM2對於超長上下文堅實的支持能力。

爲測試InternLM2在真實長文本處理任務中的能力,研究人員將一份時長3小時的公開會議錄音轉錄稿輸入模型中,並要求InternLM2從中提取出關鍵信息。測試結果表明,儘管在未校對的文本中存在較多錯別字,但InternLM2仍從中準確提煉出了關鍵信息,並總結了關鍵發言人的觀點。

InternLM2準確總結“聯合國2023年10月2日召開的聯合國貿易和發展會議會議記錄”

性能全面提升,綜合領先同量級開源模型

InternLM2的各項能力獲得全面進步,相比於初代InternLM,在推理、數學、代碼等方面的能力提升尤爲顯著,綜合能力領先於同量級開源模型。

根據大語言模型的應用方式和用戶關注的重點領域,研究人員定義了語言、知識、推理、數學、代碼、考試等六個能力維度,在55個主流評測集上對多個同量級模型的表現進行了綜合評測。評測結果顯示,InternLM2的輕量級及中量級版本性能在同量級模型中表現優異。

InternLM2的輕量級及中量級版本性能在同量級開源模型中表現優異

下面的表格對比了InternLM2各版本與ChatGPT(GPT-3.5)以及GPT-4在典型評測集上的表現。可以看到,InternLM2只用20B參數的中等規模,即在整體表現上達到了與ChatGPT比肩的水平。其中,在AGIEval、 BigBench-Hard(BBH)、GSM8K、MATH等對推理能力有較高要求的評測上,InternLM2表現甚至優於ChatGPT。

InternLM2與ChatGPT的評測結果對比

與此同時,綜合性能的增強,帶來了下游任務的全方位能力提升。新發布的InternLM2提供優秀的對話及創作體驗,支持多輪任務規劃及工具調用,並提供實用的數據分析能力。

對話及創作:更溫情、更富想象力

InternLM2不僅在客觀性能指標上提升顯著,在主觀體驗上也有明顯改善,可以爲用戶提供優秀的對話和交互體驗。研究測試表明,InternLM2-Chat可以精準地理解和遵循用戶意圖,具備較強的共情能力和豐富的結構化創作能力。下面展示幾個示例:

示例一:在嚴格的格式要求下編制課程大綱

InternLM2設計的課程大綱精準遵循用戶要求(比如格式、數量、內容等)。

示例二:以富有人文關懷的回答開解用戶

InternLM2能夠在對話中與用戶“共情”

示例三:展開想象力,編寫《流浪地球3》的劇本

InternLM2設計的具備充滿豐富的合理想象,比如外星遺蹟、量子糾纏的引入等。同時整個故事表現了人類面對危機時的勇氣和團結精神。

對話和創造的體驗進步的原因,一方面是基礎語言能力的顯著增強,另一方面也得益於微調技術的提升。InternLM2進行微調的過程使用了經過第三代數據清洗過濾技術處理的指令微調語料,同時也採用了更強的Online RLHF。研究人員在微調InternLM2的過程中,對獎勵模型和對話模型進行了三輪迭代更新,每一輪更新均針對前一輪模型的表現更新偏好數據與提示詞。在獎勵模型訓練(RM)和近端策略優化(PPO)階段,研究人員均衡採用各類提示詞,不僅提高了對話的安全性,也提升了用戶體驗。

工具調用:能力升級,更精準的工具選用,更可靠的多步規劃

基於更強大、更具泛化性的指令理解、工具篩選與結果反思等能力,InternLM2可支持複雜智能體的搭建,支持對工具進行多輪有效調用及多步驟規劃,完成複雜任務。聯合團隊針對多種任務構建了細粒度工具調用評測集T-Eval(https://open-compass.github.io/T-Eval),InternLM2-Chat-7B在該評測集上表現超越了Claude-2.1和目前的開源模型,性能接近GPT-3.5。

InternLM2工具調用能力全面提升

通過工具調用,使得大語言模型可通過搜索、計算、代碼解釋器等獲取知識並處理更復雜的問題,從而拓展應用邊界。研究人員對模型調用工具流程實施細粒度的拆解和分析,針對規劃、推理、工具選擇、理解、執行、反思等步驟進行了針對性增強和優化。

基於InternLM2通過開源智能體框架 Lagent搭建的用戶助手智能體,能夠在一次指令迴應中完成地圖查詢、路線規劃、發郵件等任務

數理推理:會做題,還會可視化分析

數學能力是大模型邏輯思維和推理能力的重要體現。上海AI實驗室對InternLM2的數學能力進行全面提升,使其達到當前開源模型的標杆水平。

基於更加科學構建的預訓練語料,InternLM2形成了很強的內生計算能力。在不依靠計算器等外部工具的情況下,在100以內的簡單數學運算上能夠做到接近100%的準確率,在1000以內達到80%左右的運算準確率。在GSM8K和MATH評測中,InternLM2-20B的表現超過了ChatGPT(GPT-3.5)。

InternLM2在100以內的簡單數學運算上能夠做到接近100%的準確率

爲應對各類複雜計算,InternLM2-Chat還可藉助代碼解釋器(Code-Interpreter)編寫代碼進行計算,或對推理的結果進行形式化驗證,從而解決計算要求更高或者演算過程更加複雜的問題。在典型的數學評測集 GSM8K 和 MATH 上,配合代碼解釋器,InternLM2取得了更高的評測分數。其中對於難度更高的 MATH 數據集,InternLM2的計算精度從 32.5 大幅提升到 51.2,甚至超過了 GPT-4 的表現。

InternLM2與ChatGPT的數學能力評測結果對比

下面的示例展示了InternLM2可以和代碼解釋器結合解決較複雜的高等數學問題。

InternLM2能夠完成積分求解等高等數學題目

基於在計算及工具調用方面強大的基礎能力,InternLM2在語言模型中具備了數據分析和可視化實用能力,進一步貼近用戶使用場景。

向InternLM2輸入國家統計局公佈的“2023年3-11月份規模以上工業企業主要財務指標(分行業)”,InternLM2能夠分析數據並繪製折線圖